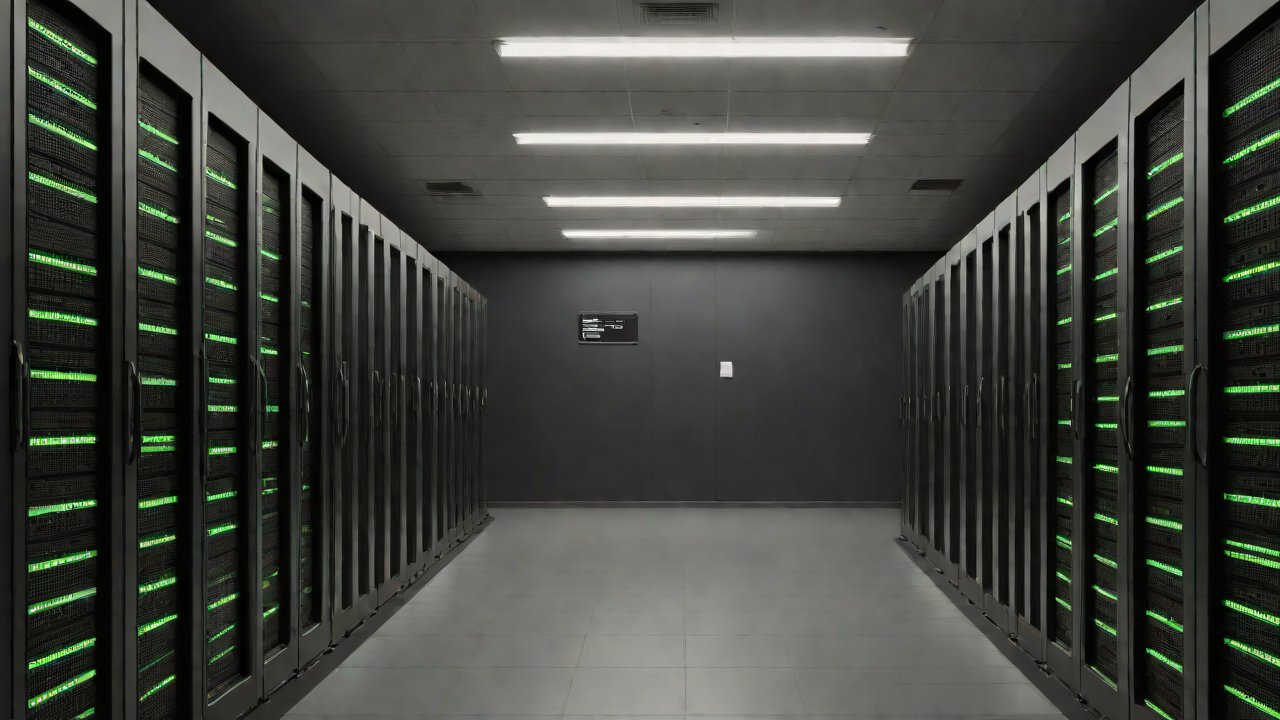

在2027年,独立站面临着来自竞争对手的高级Agent扫描愈发严峻的挑战。为了保障独立站点的安全与用户体验,反爬虫技术成为不可或缺的一部分。这一技术不仅能够识别并阻止恶意访问者的非正常行为,还能保护网站数据不被非法获取和利用。本文将详细探讨如何通过先进的反爬虫技术来识别来自竞争对手的高级Agent扫描,确保独立站的安全性和竞争力。

一、理解高级Agent与普通爬虫的区别

要构建有效的反爬虫策略,首先需要明白什么是高级Agent及它们为何会对独立站构成威胁。相较于传统的简单脚本或工具,高级Agent如Googlebot和Serpapi等更复杂的爬虫能够模仿人类用户的浏览行为,从而避开常规的检测手段。这些高级Agent不仅频率更高、持续时间更长,还能通过模拟用户交互来规避防护措施。

二、采用多维度识别技术

为了有效应对来自竞争对手的高级Agent扫描,独立站可以采取以下几种策略:

1. 基于行为的异常检测

这种技术依赖于对用户行为进行实时监控和分析。例如,如果一个IP在短时间内频繁访问多个页面且访问模式与普通用户的浏览习惯不符,系统会标记该用户为可疑对象。通过设置阈值来判断访问频率、停留时间等参数是否超出了正常范围。

2. 使用指纹识别技术

现代网站可以通过收集并分析用户的浏览器特性(如屏幕分辨率、语言偏好、时区信息)形成独特的设备指纹。这些数据可以帮助辨别是否为同一设备或用户,有效区分出正常的用户访问与恶意的爬虫活动。

3. 动态验证码机制

动态验证码可以增加破解难度,使非人操作难以完成任务。例如,滑块验证不仅要求识别图片中的缺口位置,还可能加入额外的时间响应限制等复杂因素,进一步提高安全性。

三、结合机器学习与人工智能技术

借助于机器学习和AI的深度应用,反爬虫系统能够自动学习并适应不断变化的网络环境。通过对大量历史数据的学习训练模型,识别模式和异常行为的能力将显著提升。具体实现方式包括但不限于:

1. 异常流量检测

通过构建数据集来训练算法识别正常访问与异常入侵之间的差异。这样即使新形式的攻击出现也能迅速做出响应。

2. 自动化特征工程

利用自动化的特征提取技术,简化复杂度的同时提高模型准确率。这包括从用户交互日志中自动选择最有价值的信息进行分析。

四、建立全面的安全防护体系

为了确保反爬虫策略的有效性,独立站还需要构建一个综合性的安全架构:

1. 实施多层次防御

将上述不同类型的检测手段结合起来使用,形成多层防线。这样即使某个环节被突破,整体防御仍然能有效运作。

2. 定期更新与维护

网络安全环境是动态变化的,因此需要定期检查系统是否存在漏洞,并根据实际情况调整策略和配置。

3. 加强用户教育

虽然重点在于技术层面的防范,但也不能忽视对网站管理员和用户的培训。教导他们如何辨别可疑行为以及在遇到潜在威胁时采取正确的应对措施。

通过上述方法的应用与实施,2027年的独立站可以更好地抵御来自竞争对手的高级Agent扫描,维护自身安全并为用户提供优质的在线体验。